Ist ein Tumor im Laufe einer mehrmonatigen Behandlung geschrumpft, oder haben sich in der Zwischenzeit gar neue Geschwulste entwickelt? Um Fragen wie diese zu klären, werten Ärzte unter anderem CT- und MR-Aufnahmen aus. Meist werden die Tumoren dabei nur visuell bewertet und neue Geschwulste manchmal übersehen. „Unser Programmpaket erhöht die Sicherheit bei der Vermessung und Nachverfolgung der Tumoren“, erläutert Mark Schenk vom Fraunhofer-Institut für Bildgestützte Medizin MEVIS in Bremen. »Die Software kann zum Beispiel erfassen, wie sich das Volumen eines Tumors im Laufe der Zeit verändert und unterstützt beim Aufspüren neuer Geschwulste.«

Das Paket ist als Baukastensystem ausgelegt und kann Medizintechnik-Herstellern helfen, die Verlaufskontrolle zu automatisieren. Das Besondere: Um die Ergebnisse zu verbessern, verwendet die Software Deep Learning – eine neue Art des maschinellen Lernens, die deutlich über bisherige Ansätze hinausgeht. Hilfreich ist das Verfahren unter anderem für die Segmentierung. So bezeichnen Experten jenen Arbeitsschritt, der bei CT- und MRT-Bildern die genauen Umrisse der Organe erfasst. Bei den bisher verfügbaren Segmentierungsprogrammen sucht der Rechner nach fest definierten Bildmerkmalen, etwa nach bestimmten Grauwert-Unterschieden. „Doch dabei kommt es nicht selten zu Fehlern“, erläutert Fraunhofer-Forscher Markus Harz. „Die Software ordnet dann Bereiche der Leber zu, die gar nicht zum Organ gehören.“ Diese Fehler müssen die Mediziner oft zeitaufwändig korrigieren.

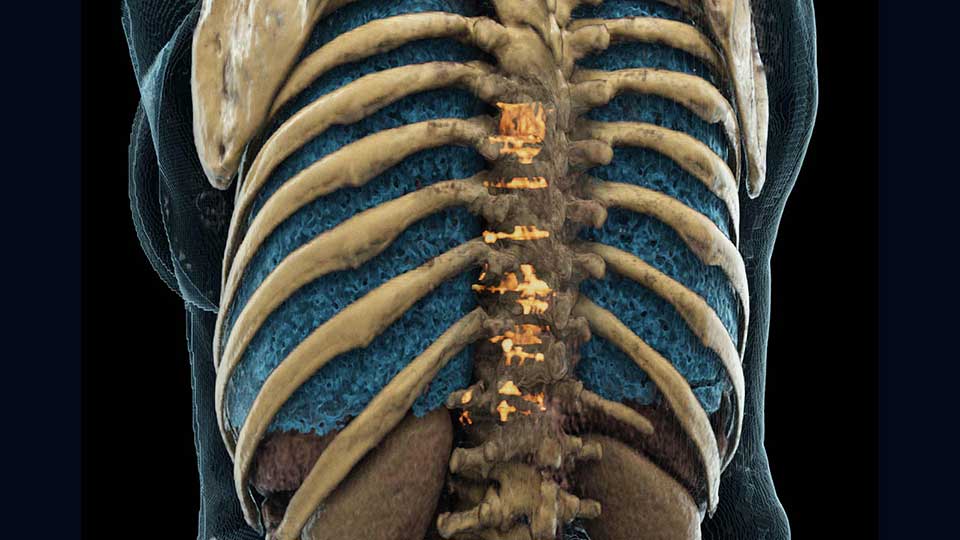

Auch Knochenmetastasen kann die Software aufspüren

Die neuen Deep-Learning-Ansätze versprechen bessere Ergebnisse und sollen den Ärzten kostbare Zeit sparen. Um die Funktionsweise ihrer selbstlernenden Software zu demonstrieren, trainierten sie die Fraunhofer-Forscher mit Hilfe von CT-Leberaufnahmen von 149 Patienten. Das Ergebnis: Je mehr Datensätze das Programm analysierte, umso besser konnte es die Leberumrisse automatisch identifizieren.

Ein weiteres Einsatzfeld ist die sogenannte Bildregistrierung. Hier bringt eine Software verschiedene Aufnahmen, die zu unterschiedlichen Zeiten gemacht wurden, so zur Deckung, dass sie die Mediziner direkt vergleichen können. Hierbei kann die Bildregistrierung das maschinelle Lernen bei einer besonders schwierigen Aufgabe unterstützen, und zwar bei dem Aufspüren von Knochenmetastasen in Aufnahmen des Oberkörpers, auf denen Hüftknochen, Rippen und der Wirbelsäule. Bislang werden diese Metastasen unter dem in der klinischen Praxis herrschenden Zeitdruck oft übersehen. Deep-Learning-Methoden können helfen, sie zuverlässig zu entdecken und damit die Therapiechancen zu verbessern.

Quelle: idw